麻省理工学院最新研究:人工智能帮助机器人实现全身操控物体

想象一下,你想把一个又大又重的箱子搬上楼。你可能会张开手指,用双手举起箱子,然后用前臂顶住箱子,用胸部保持平衡,用整个身体来操纵箱子。

人类通常擅长全身操纵,但机器人却很难胜任此类任务。对机器人来说,盒子可能接触到搬运者手指、手臂和躯干上任何一点的每一个位置,都代表着一个接触事件,机器人必须对其进行推理。由于潜在的接触事件数以亿计,这项任务的规划工作很快就变得难以完成。

data-backh="325" data-backw="578" data-galleryid="" data-ratio="0.5620608899297423" data-type="gif" data-w="854">

data-backh="325" data-backw="578" data-galleryid="" data-ratio="0.5620608899297423" data-type="gif" data-w="854">

现在,麻省理工学院的研究人员找到了一种简化这一过程的方法,这种方法被称为 "富接触操纵规划"。他们使用了一种称为平滑的人工智能技术,这种技术能将许多接触事件归纳为数量较少的决策,从而使即使是简单的算法也能为机器人快速确定有效的操纵计划。

虽然这种方法仍处于早期阶段,但它有可能使工厂使用较小的移动机器人,这些机器人可以用整个手臂或身体来操纵物体,而不是只能用指尖抓取的大型机械臂。这可能有助于减少能耗,降低成本。此外,这种技术还可用于执行火星或其他太阳系天体探索任务的机器人,因为它们只需使用机载计算机就能快速适应环境。

data-backh="311" data-backw="553" data-cropselx1="0" data-cropselx2="553" data-cropsely1="0" data-cropsely2="311" data-ratio="0.5620608899297423" data-type="png" data-w="854">

data-backh="311" data-backw="553" data-cropselx1="0" data-cropselx2="553" data-cropsely1="0" data-cropsely2="311" data-ratio="0.5620608899297423" data-type="png" data-w="854">

"电气工程与计算机科学(EECS)专业研究生 H.J. Terry Suh 是这项技术相关论文的共同第一作者,他说:"如果我们能够利用模型来利用这类机器人系统的结构,那么就有机会加快做出这些决策和制定接触丰富的计划的整个过程,而不是把它当作一个黑盒子系统。

与 Suh 一起参与论文撰写的还有共同第一作者、波士顿动力人工智能研究所的机器人专家 Tao Pang 博士(23岁),电子工程与电子科学研究生杨璐洁,以及资深作者 Russ Tedrake,他是电子工程与电子科学系、航空航天系和机械工程系的丰田教授,也是计算机科学与人工智能实验室(CSAIL)的成员。这项研究成果将于本周发表在《电气和电子工程师学会机器人技术论文集》(IEEE Transactions on Robotics)上。

▍关于机器人的强化学习

强化学习是一种机器学习技术,在这种技术中,代理(如机器人)通过试错来学习完成任务,并在接近目标时获得奖励。研究人员说,这种学习方式采用的是黑箱方法,因为系统必须通过试错来了解世界的一切。

它已被有效地应用于接触式操纵规划,在这种规划中,机器人试图学习以特定方式移动物体的最佳方法。

data-backh="311" data-backw="553" data-cropselx1="0" data-cropselx2="553" data-cropsely1="0" data-cropsely2="311" data-ratio="0.562962962962963" data-type="png" data-w="1080">

data-backh="311" data-backw="553" data-cropselx1="0" data-cropselx2="553" data-cropsely1="0" data-cropsely2="311" data-ratio="0.562962962962963" data-type="png" data-w="1080">

但是,由于机器人在决定如何使用手指、手掌、手臂和身体与物体互动时,必须对数十亿个潜在接触点进行推理,因此这种试错方法需要大量计算。

“强化学习可能需要经过数百万年的模拟时间才能真正学习策略,”Suh 补充道。

另一方面,如果研究人员利用他们对系统的了解以及他们希望机器人完成的任务专门设计一个基于物理的模型,那么该模型就会包含有关这个世界的结构,从而使其更加高效。

然而,当涉及丰富的接触操作计划时,基于物理的方法并不像强化学习那么有效——Suh 和 Pang 想知道为什么。

data-backh="311" data-backw="553" data-cropselx1="0" data-cropselx2="553" data-cropsely1="0" data-cropsely2="311" data-ratio="0.562962962962963" data-type="png" data-w="1080">

data-backh="311" data-backw="553" data-cropselx1="0" data-cropselx2="553" data-cropsely1="0" data-cropsely2="311" data-ratio="0.562962962962963" data-type="png" data-w="1080">

他们进行了详细分析,发现一种被称为平滑的技术能让强化学习表现如此出色。

机器人在决定如何操纵物体时,可能做出的许多决定在整体上并不重要。例如,一根手指的每一次微小调整,无论是否会导致与物体的接触,都不太重要。平滑平均消除了许多不重要的中间决策,留下了一些重要的决策。

data-backh="311" data-backw="553" data-cropselx1="0" data-cropselx2="553" data-cropsely1="0" data-cropsely2="311" data-ratio="0.562962962962963" data-type="png" data-w="1080">

data-backh="311" data-backw="553" data-cropselx1="0" data-cropselx2="553" data-cropsely1="0" data-cropsely2="311" data-ratio="0.562962962962963" data-type="png" data-w="1080">

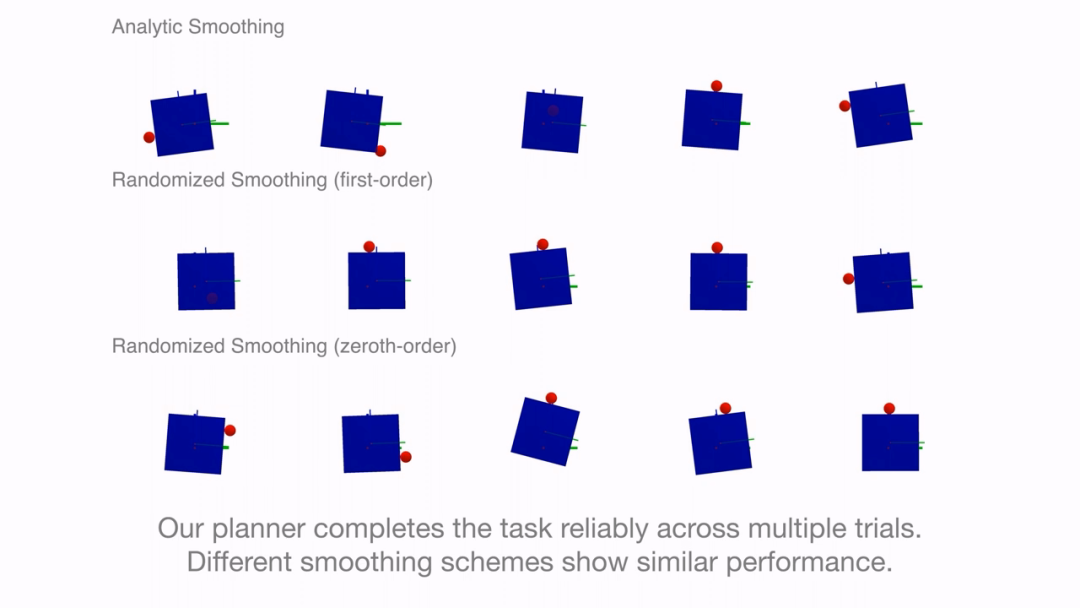

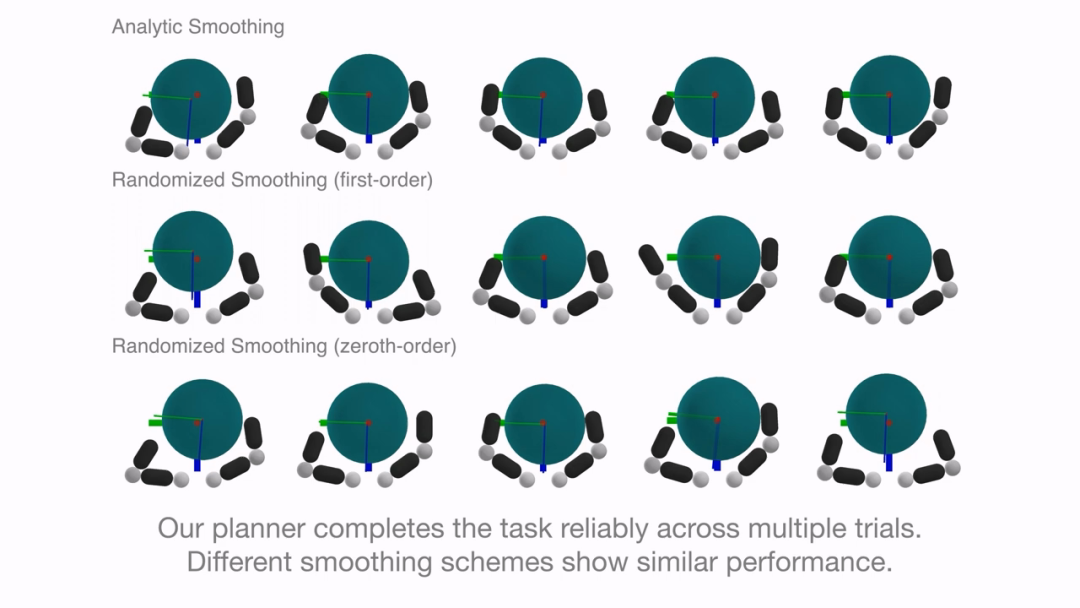

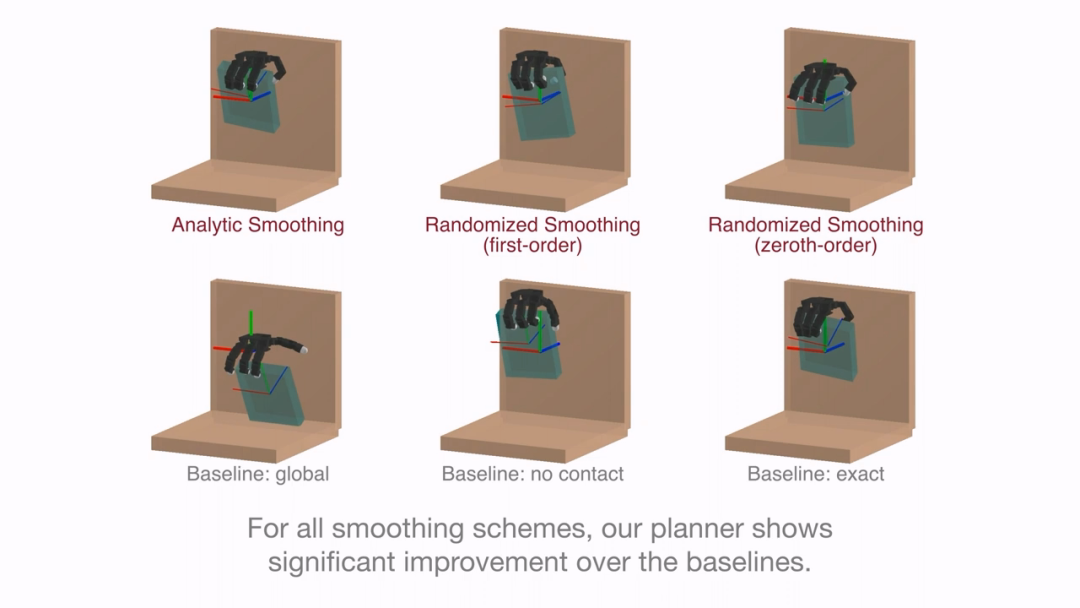

强化学习通过尝试多个接触点,然后计算出结果的加权平均值,从而隐性地实现平滑。根据这一见解,麻省理工学院的研究人员设计了一个简单的模型,该模型可以执行类似的平滑处理,使其能够专注于机器人与物体之间的核心互动,并预测长期行为。他们的研究表明,这种方法在生成复杂计划方面与强化学习一样有效。

"Pang 说:"如果对问题有更多的了解,就能设计出更有效的算法。

▍如何将算法进行重新组合是个问题

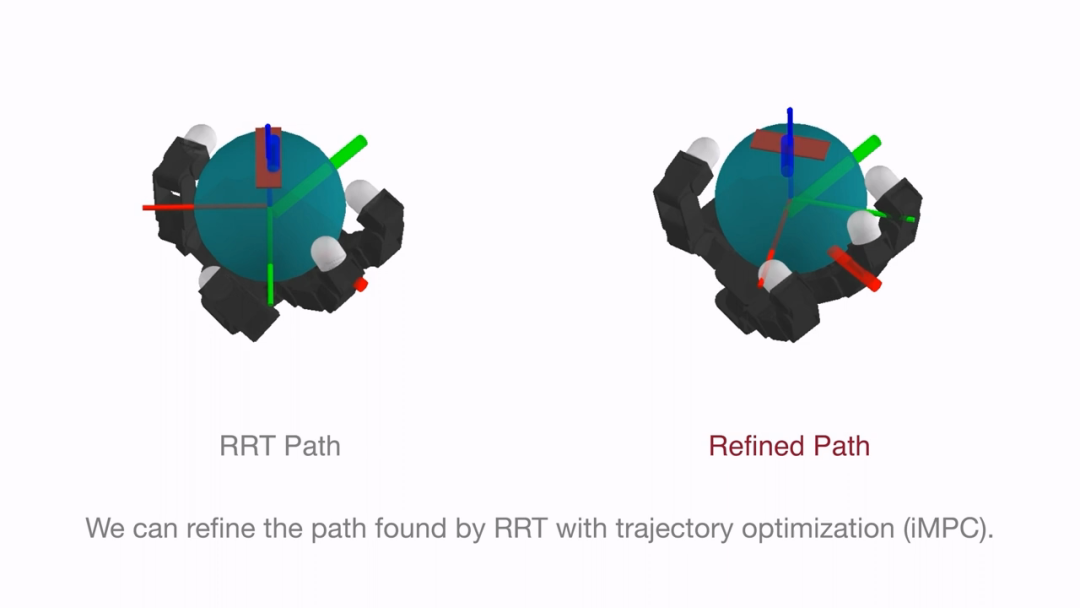

尽管平滑处理大大简化了决策,但搜索剩余决策仍然是一个难题。因此,研究人员将他们的模型与一种算法相结合,这种算法可以快速高效地搜索机器人可能做出的所有决定。

通过这种组合,在标准笔记本电脑上的计算时间缩短到约一分钟。

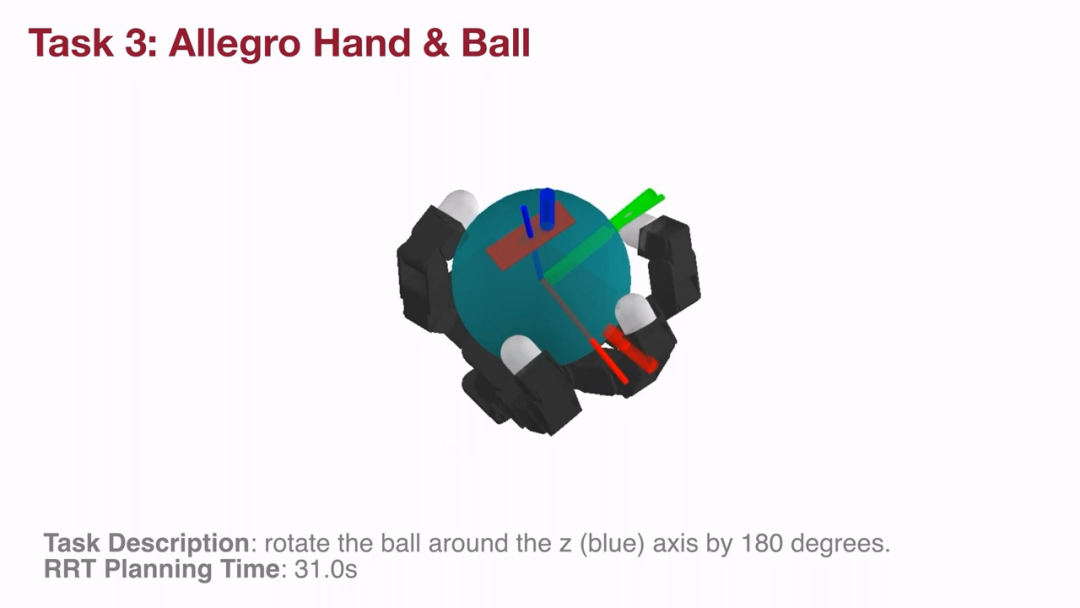

他们首先在模拟实验中测试了自己的方法,在模拟实验中,机器人的手被赋予了移动钢笔到所需配置、开门或拿起盘子等任务。在每种情况下,他们基于模型的方法都取得了与强化学习相同的性能,但所需时间只有强化学习的一小部分。当他们在真实机械臂上对模型进行硬件测试时,也看到了类似的结果。

data-backh="311" data-backw="553" data-cropselx1="0" data-cropselx2="553" data-cropsely1="0" data-cropsely2="311" data-ratio="0.562962962962963" data-type="png" data-w="1080">

data-backh="311" data-backw="553" data-cropselx1="0" data-cropselx2="553" data-cropsely1="0" data-cropsely2="311" data-ratio="0.562962962962963" data-type="png" data-w="1080">

实现全身操纵的理念同样适用于灵巧的人手规划。特德拉克说:"以前,大多数研究人员都认为强化学习是唯一适用于灵巧双手的方法,通过从强化学习中提取(随机)平滑这一关键思想,他们可以让更多传统的规划方法也非常有效。"

data-backh="311" data-backw="553" data-cropselx1="0" data-cropselx2="553" data-cropsely1="0" data-cropsely2="311" data-ratio="0.562962962962963" data-type="png" data-w="1080">

data-backh="311" data-backw="553" data-cropselx1="0" data-cropselx2="553" data-cropsely1="0" data-cropsely2="311" data-ratio="0.562962962962963" data-type="png" data-w="1080">

然而,他们开发的模型依赖于对真实世界的简单近似,因此无法处理非常动态的运动,例如物体坠落。他们的方法虽然对速度较慢的操纵任务有效,但无法创建一个能让机器人将易拉罐扔进垃圾桶的计划。未来,研究人员计划改进他们的技术,使其能够处理这些高动态运动。